Habana Gaudi: AWS setzt auf Intel-Beschleuniger für KI-Training

Amazons Cloud-Computing-Sparte AWS verwendet die Steckkarten der von Intel für 2 Milliarden US-Dollar zugekauften Habana Labs.

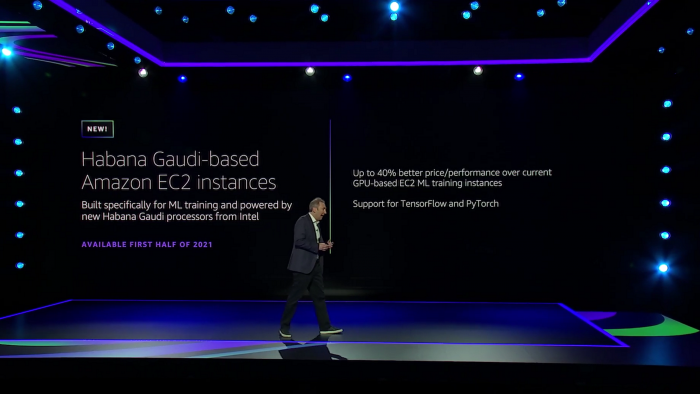

Amazon Web Services (AWS) hat neue EC2-Instanzen ankündigt, diese werden Intels Habana Gaudi nutzen und sollen im ersten Halbjahr 2021 verfügbar sein. Gedacht sind diese für das Trainieren von tiefen neuronalen Netzen, als Beispiele für das Deep Learning nennt AWS etwa Sprachverarbeitung, Objekterkennung sowie -klassifizierung und Empfehlungen für Produkte in Online-Shops.

Intel hatte die Habana Labs im Dezember 2019 für 2 Milliarden US-Dollar übernommen. Habana ist ein isrealisches Startup, das neben dem Gaudi für Training auch den Goya für Inferencing entwickelt hat. Intel will so sein Angebot für künstliche Intelligenz (KI) verbessern, der KI-Siliziummarkt soll bis zum Jahr 2024 ein Volumen von mehr als 25 Milliarden US-Dollar erreichen.

Die EC2-Instanzen bestehen aus bis zu acht Gaudi-Beschleunigern, welche als Mezzanine-Module montiert sind. Laut AWS soll die Leistung pro US-Dollar bei maschinellem Lernen um bis zu 40 Prozent höher ausfallen als bei bisherigen Instanzen mit GPUs statt mit den Habana-Chips. Als Vergleich wurde hierbei die teure p4d.24xlarge-Konfiguration mit acht Nvidia A100 herangezogen.

Der Gaudi ist ein ASIC, den Intel in einem 7-nm-Verfahren beim weltgrößten Auftragsfertiger TSMC produzieren lässt. Der Gaudi nutzt sogenannte Tensor Processing Cores (TPCs), genauer VLIW-Vektoreinheiten, und ist mit 32 GByte HBM2-Stapelspeicher ausgestattet, um möglichst viele Daten lokal vorhalten zu können. Die Mezzanine-Module sind per PCIe Gen4 x16 angebunden, ein Host-Prozessor wie ein Intel Xeon ist erforderlich.

Habanas Traning-ASIC kann mit typischen Formaten wie FP32, INT8, INT8 und BF16 umgehen. Folgerichtig unterstützt das Software Development Kit auch Frameworks wie Tensorflow oder Pytorch und Habana will eine Migrationsanleitung zur Verfügung stellen (PDF).

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed